Sukurta technologija, nebeleisianti pasikliauti tuo, ką matome savomis akimis

Technologijos ir istorija

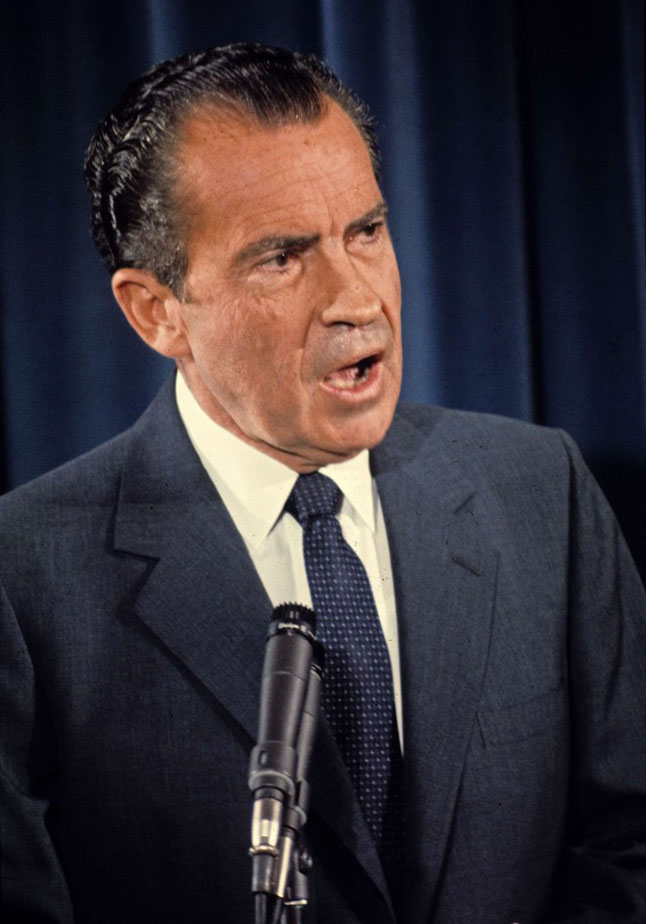

Prezidentas buvo tiesiog įsiutęs. Problemų kėlė ne tik žiniasklaida – jį labiau erzino technologija, kuria ta žiniasklaida naudojosi. Elektroninė žiniasklaida viską pakeitė. Žmonės buvo prikaustyti prie ekranų.

„Dar niekada negirdėjau ir nemačiau tokių žeidžiančių, pagiežingų, tiesą iškraipančių reportažų“, – sakė jis spaudos konferencijoje.

Kaip anuomet, vieną 1973-iųjų spalio dieną, žurnalistams sakė JAV prezidentas Richardas Nixonas, televizijos naujienų amžius kėsinasi sugriauti amerikiečių pasitikėjimą. Tada jis dar nežinojo, kaip katastrofiškai pasibaigs jo prezidentavimo era. 1974 m. rugpjūtį pranešdamas apie savo atsistatydinimą, R. Nixonas kalbėjo tiesiai į televizijos kamerą. Net ir po pusšimčio metų įrašas palieka didžiulį įspūdį – ne vien dėl to, kad jame užfiksuotas svarbus istorinis momentas, tačiau dar ir dėl galios, kurią spinduliuoja televizijos transliacija.

Net ir šiais laikais, kai informacijos amžius yra gerokai paveiktas interneto, vaizdo įrašas – vis dar itin įtraukus formatas. A. LaFrance teigimu, tikralaikių naujienų jovale pamatyti kažką savomis akimis – didelis džiaugsmas ir vertybė.

Bent jau taip buvo.

Scanpix nuotr.

Vieno žodžiai – kito burnoje

Nepasitikėjimui žiniasklaida ir taip jau sparčiai didėjant, kelią aktyviai skinasi nauja technologija, priversianti dar labiau suabejoti, ar tai, ką matome, yra tiesa ar išsigalvojimas. Įtaigaus retušavimo priemonės, jau įprastos fotografijoje, atkeliauja ir į video pasaulį. Ir tai yra kartu ir nuostabu, ir baugu.

Kompiuterių inžinieriai jau geba sukurti nuo tikrovės beveik nesiskiriančius vaizdo įrašus, kuriuose, pavyzdžiui, vieno asmens žodžiai „įdedami“ į kito asmens lūpas.

Ar jau peržiūrėjote video, kuriame kalba Barackas Obama? Tiesą pasakius, ten kalba visai ne tas Obama, kurį matote. Vaizdas susintetintas: garso įrašas vienas, o vaizdo – kitas. Čia jie sujungti į viena.

Šį vaizdo klipą parengė Vašingtono universiteto (JAV) tyrėjai. Tam jie panaudojo savo pačių sukurtą algoritmą, kuris iš kalbančiojo „paima“ garsą ir paverčia jį tikrovišku vaizdu. Rezultatas – matome žmogų, kalbantį tai, ko jis iš tikrųjų nekalbėjo. Toliau įraše pateikiamas palyginimas, kaip iš tikrųjų nufilmuota tai, ką kalbėjo B. Obama, ir kaip ta pati kalba atrodo dirbtinai sugeneruotame klipe.

Tokio pobūdžio eksperimentui B. Obama pasirinktas neatsitiktinai – viešojoje erdvėje yra apstu aukštos kokybės jo vaizdo įrašų, o bandymams būtent to ir reikėjo. Kad sukurtų nuo tikrovės mažai besiskiriančią kalbančiojo burnos tekstūrą, tyrėjai turėjo į sistemą įvesti daugybę B. Obamos veido vaizdų. Šie vaizdai buvo sluoksniais dedami ant pasirinktos bazinės burnos formos. Kad pagal garso medžiagą susintetintų judančią burną, tyrėjai naudojo vadinamąjį pasikartojantį neuroninį tinklą (pasikartojantys neuroniniai tinklai dar naudojami veido ir kalbos atpažinimui). Panaudota milijonai video kadrų. Pagaliau tam, kad viskas atrodytų glotnu ir tikroviška ir kad sugeneruotas vaizdas gražiai žiūrėtųsi bendrame fone, pritaikyta speciali įkomponavimo technika, – taip sintetinio vaizdo kūrimo principą glaustai paaiškina A. LaFrance.

Šį vaizdo sintetinimo būdą ir atliktų eksperimentų išvadas tyrėjai ketina pristatyti ateinantį mėnesį vyksiančioje kompiuterinės grafikos ir interaktyviųjų technologijų konferencijoje.

„Mūsų idėja – šią technologiją panaudoti tam, kad pagerėtų komunikacija tarp žmonių“, – sako ataskaitos bendraautorė, Vašingtono universiteto kompiuterijos ir kompiuterių inžinerijos katedros dėstytoja Ira Kemelmacher-Shlizerman. Jos nuomone, šią technologiją būtų galima panaudoti vaizdo konferencijose. Pavyzdžiui, jei dėl ryšio problemų vaizdo transliacija būtų negalima, vaizdas galėtų būti sugeneruojamas pagal garsą. Ši technika, pasak specialistės, dar galėtų būti naudojama virtualiojoje ar vadinamojoje išplėstinėje realybėje, sudarant įspūdį, kad, žmogus, kurio iš tikrųjų šalia nėra, yra visai čia pat.

„Mes aiškinamės ne tik tai, kaip „Siri“ suteikti žmogiškąjį veidą arba kaip GPS imtuvą priversti prabilti B. Obamos balsu, – sako ataskaitos bendraautoris Supasornas Suwajanakornas. – Mes siekiame išmokti fiksuoti asmenybes.“ Tad nenuostabu, teigia straipsnio autorė A. LaFrance, kad šiais eksperimentais susidomėjo ir kai kurios stambios technologijų bendrovės, kaip antai „Samsung“, „Google“, „Facebook“ ir „Intel“. Jų interesai, žinoma, susiję su galimybėmis patobulinti dirbtinio intelekto, išplėstinės realybės ir robotikos sritis. „Tikiuosi, kad mums pavyks ištirti šias žmogiškąsias savybes ir perkelti jas robotams – taip jie taptų panašesni į žmones“, – viliasi pašnekovas.

Patys tyrėjai pripažįsta šiek tiek nerimaujantys

Vis dėlto, pasak A. LaFrance, ši technologija gali būti panaudota ir kitu tikslu – siekiant apgauti. Jau ir taip neretai susiduriama su suklastotomis nuotraukomis, netikromis paskyromis socialiniuose tinkluose ir įvairiomis kitokiomis apgaulėmis. Įsivaizduokite, sako ji, kokia kiltų painiava, jei išplistų vaizdo įrašas, kuriame prezidentas sako tai, ko iš tikrųjų niekada nesakė.

„Nerimo yra“, – pripažįsta I. Kemelmacher-Shlizerman. Tačiau ji įsitikinusi, kad geroji pusė nusveria blogąją, ir mano, kad šios technikos sukūrimas – svarbus žingsnis į priekį.

Nustatyti, ar įrašas tikras, ar suklastotas panaudojant minėtą techniką, specialistams šiuo atveju nebūtų sudėtinga. Sintetindami B. Obamos kalbos vaizdo įrašą, tyrėjai naudojo tikrą filmuotą medžiagą, todėl priemonių, kurios padėtų atpažinti originalų įrašą, yra.

„Turėdami internete esančių vaizdo įrašų duomenų bazę, galime joje panaršę pagal galvą ir foną identifikuoti suklastotus vaizdo klipus, – sako S. Suwajanakornas. – Dar vienas artefaktas, į kurį reikėtų atkreipti dėmesį, yra kalbančiojo burnos [ir] dantų zonos ryškumo stoka. Tai gali būti nepastebima plika akimi, tačiau būtų galima nesunkiai sukurti pakankamai patikimą programą, kuri palygintų burnos zonos ryškumą su likusios vaizdo medžiagos ryškumu.“

Taigi, priemonių apsisaugoti yra, tačiau, technologijoms tobulėjant, rizikos bus visada. Ne kiekvienas mokės pasinaudoti duomenų bazėmis ir programomis, kad išsiaiškintų, ar vaizdo įrašas tikras, ar ne. Daugeliui gal net į galvą neateis, kad autentiškai atrodantis vaizdo įrašas gali būti netikras. Na, o tie, kurie nieko bloga neįtardami dalysis suklastotais įrašais, tiesiog dar labiau padidins nepasitikėjimą specialistais, kurie galėtų šiems dalykams suteikti prasmės.

„Manau, kad žmonės nebetikės vaizdo įrašais – lygiai taip, kaip netiki nuotraukomis, jei žino, kad egzistuoja tokios priemonės kaip „Photoshopas“, – sako S. Suwajanakornas. – Tai gali būti ir gerai, ir blogai, o mes turime stengtis atrasti patikimesnių įrodymų šaltinių.“

Tačiau ką reiškia duomenų patikimumas, jei nebegalima tikėti tuo, ką matai savomis akimis, klausia straipsnio autorė A. LaFrance. Pasak jos, realybė jau gerokai iškraipyta, todėl darosi labai sunku atskirti, kas tikra, o kas – ne.

Rašyti komentarą